从会回答到会行动:Agentic RL 的原理与评估

大模型已经很会“说话”了,但离“会做事”还有一段距离。

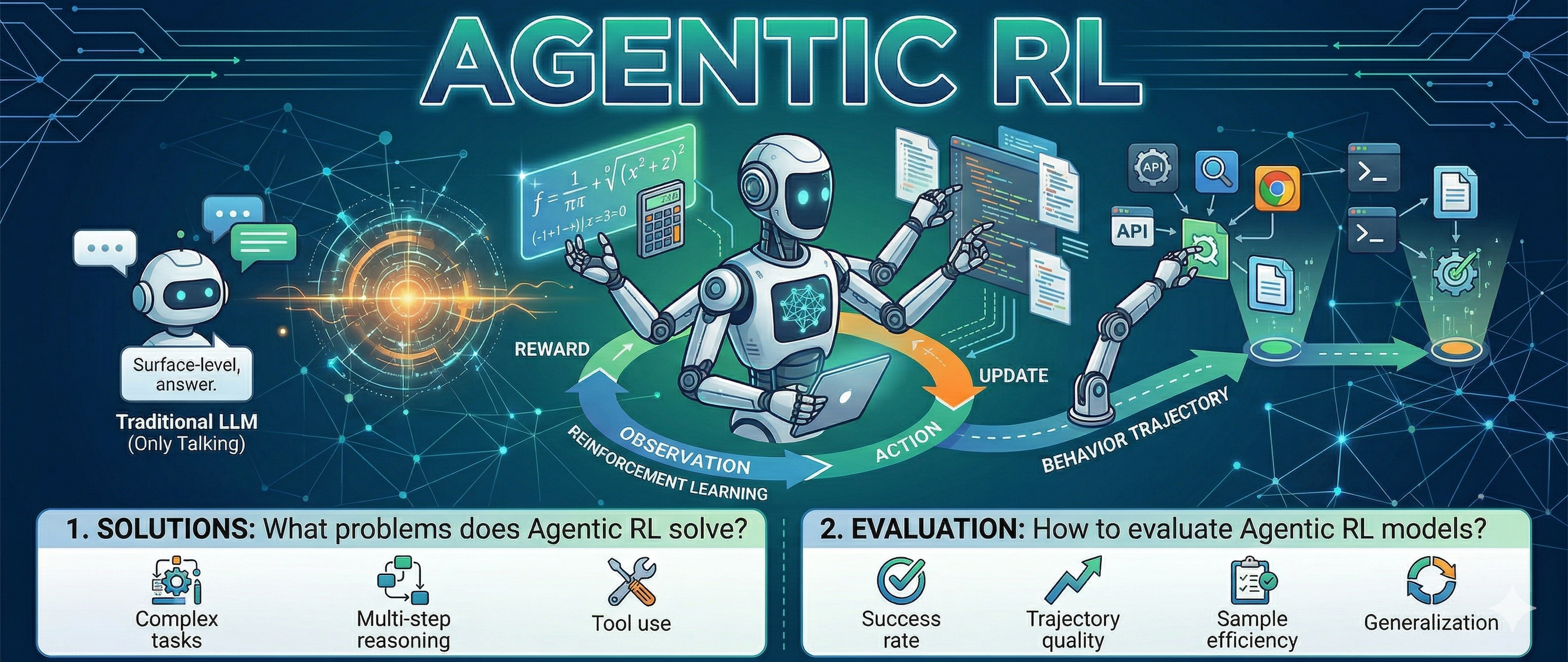

比如,给模型一个数学题、一个代码仓库,或者一组可调用工具,我们真正想要的并不是一句表面流畅的回答,而是它能够分步思考、调用工具、根据反馈调整策略,最终把任务完成。这也是为什么最近大家越来越关注一个关键词:Agentic RL。

简单来说,Agentic RL 不是把大模型当成一个只会一次性输出答案的聊天机器,而是把它当成一个能在环境中持续决策的智能体,并用强化学习去优化它的行为轨迹。

这篇文章重点梳理两个问题:

- Agentic RL 到底在解决什么问题;

- 一个 Agentic RL 模型,应该怎么评估。

什么是 Agentic RL

Agentic RL 可以理解为:把 LLM 作为策略模型,放进“感知—决策—执行”的循环里,用强化学习优化它在多步任务中的表现。

它和传统后训练最大的不同在于:优化对象变了。

传统的偏好对齐或单轮后训练,更像是在做这样一件事:

- 给模型一个 prompt;

- 让它生成一个回答;

- 根据这个回答好不好,给一个奖励。

这种方式很适合做对话助手,因为目标是“生成更好的单次回答”。

但如果任务变成:

- 先理解问题;

- 再拆解步骤;

- 必要时调用工具;

- 根据工具返回结果继续推理;

- 最后再输出结论;

那它就不再是一个“一步到位”的生成问题,而变成了一个多步序贯决策问题。这正是强化学习更擅长的场景。

Agentic RL 和传统 LLM 后训练的根本区别

如果从强化学习里的 MDP(Markov Decision Process)视角看,区别会非常清楚。

MDP 可以理解成强化学习里描述“智能体如何一步步做决策”的基本框架。它通常包含五个要素:状态(state)、动作(action)、状态转移(transition)、奖励(reward)、折扣因子(discount factor)。放到 Agent 场景里,就是:模型看到当前上下文,决定下一步是继续推理、调用工具还是执行操作,然后根据返回结果继续往下走,直到任务完成。

1. 状态不再是静态 prompt,而是动态上下文

传统单轮优化里,状态几乎就是用户输入本身。

但在 Agentic RL 里,状态会随着过程不断演化:

- 初始问题;

- 中间推理结果;

- 工具调用返回值;

- 环境反馈;

- 历史上下文。

也就是说,模型不是只看“用户一开始问了什么”,而是要看“我已经做到了哪一步”。

2. 动作不再只是生成文本

传统训练里,动作通常只有一个:继续生成 token。

但 Agentic RL 里,动作空间会更丰富,大致可以分为两类:

内部推理动作:模型在上下文中进行思考和规划,比如生成推理步骤、拆解子问题、输出中间结论。这些动作不涉及外部系统,但会影响后续的决策路径。

外部交互动作:模型主动与外部环境发生交互,比如调用搜索引擎获取信息、使用代码执行器运行程序、浏览网页、读写文件等。这些动作的特点是会带来新的观察结果,模型需要根据返回的反馈继续决策。

所以它优化的不只是“说什么”,而是“下一步该做什么”。

3. 奖励不再只看最后一句,而是看整个轨迹

在很多复杂任务里,最后答对当然重要,但过程同样重要。

一个模型可能最终答对了,但:

- 推理非常冗长;

- 工具用得很乱;

- 中间步骤不稳定;

- 格式不规范。

Agentic RL 的目标,就是把这些都纳入优化对象。它追求的是长期累积回报,而不是单次输出的奖励。

为什么只靠监督学习还不够

监督微调(SFT)当然很重要,但它有天然上限。

因为 SFT 的本质是“模仿答案”。它擅长教会模型:

- 按什么格式输出;

- 什么样的回答像是对的;

- 常见题型该怎么写。

但它不擅长解决这类问题:

- 如果训练数据里的推理路径不是最优的怎么办?

- 如果任务需要探索多种策略怎么办?

- 如果真正重要的是长期结果,而不是某一步的局部正确怎么办?

这就是强化学习介入的原因。通过试错,模型可以自己生成多个候选轨迹,再根据奖励去学习哪些路径更优。于是,它不再只是复制人类答案,而是有机会超越训练数据里现成的解法。

Agentic RL 的训练逻辑

在 Agentic RL 场景里,一条常见路线是:

预训练 → SFT → 强化学习

这里的“预训练”更多是在讲完整训练链路。实际做 Agentic RL 时,通常不会从零预训练,而是直接基于一个已有的大模型继续训练。这个已有模型可能是只做过预训练的 base model,也可能是已经做过 SFT、RLHF 或其他对齐训练的 instruct/chat model。

1. 预训练:获得通用语言能力

这是模型会“读”和“写”的基础,但还不会做具体任务。

2. SFT:学会任务格式和基本套路

在大多数实践中,SFT 是 Agentic RL 非常重要的前置步骤。因为如果模型连基本输出格式都不会,强化学习的探索效率会非常低。

SFT 主要解决几个问题:

- 学会结构化输出;

- 学会

Step 1 / Step 2 / Final Answer这类任务格式; - 建立一个可用的初始策略;

- 缩小后续 RL 的探索空间。

不过值得一提的是,SFT 并非严格的必要条件。DeepSeek-R1-Zero 的实验表明,直接从 base model 上做 RL,模型也能自发涌现出推理能力和格式规范,只是效率和稳定性不如先 SFT 再 RL 的路径。所以“先 SFT 再 RL”更多是一条经过验证的高效路径,而不是唯一选择。

3. RL:通过试错优化策略

有了 SFT 打底后,强化学习才真正发挥作用。此时优化的重点不再是“像不像训练样本”,而是“能不能更稳定、更高效地完成任务”。

Agentic RL 常用的训练方法

在具体训练时,Agentic RL 可以使用不同的强化学习方法。早期比较常见的是 PPO,它也是 RLHF 中经常被提到的方法。PPO 的经典做法是额外训练一个与策略模型同等规模的 critic(价值网络) 来估计每一步的回报基线,这在小模型上问题不大,但当策略模型本身已经有数十亿甚至上千亿参数时,再维护一个同等规模的 critic 网络,显存和计算开销就会非常高。

为了解决这个问题,后来出现了 GRPO(Group Relative Policy Optimization) 这类方法。GRPO 的核心思路是不需要额外的 critic 网络,而是对同一个问题采样一组回答,用组内的相对排序来估计基线,从而大幅降低训练开销。这也是它更适合大模型推理训练的关键原因。

这些方法的共同目标,是让模型在多次尝试中比较不同行动轨迹的好坏,并根据奖励信号强化更有效的策略。不同方法之间的差异,主要体现在训练稳定性、资源开销,以及如何控制模型更新幅度上。

奖励函数:Agentic RL 成败的核心

如果说 SFT 决定了模型有没有起跑线,那奖励函数决定了它会往哪个方向跑。

奖励函数本质上定义了什么叫“好的行为”。

对于数学推理任务,最简单的奖励可以是:

- 答对:1;

- 答错:0。

这就是最典型的准确率奖励。但如果想把模型训练成真正好用的 agent,这显然不够。因为一个好 agent 不只要“对”,还要:

- 过程合理;

- 成本可控;

- 格式清晰;

- 工具使用得当。

因此更常见的做法是设计组合式奖励:

- 准确率奖励:最终答案正确给

1,错误给0; - 长度惩罚:答案虽然对,但如果过于冗长,奖励会被打折。比如同样答对,有的答案拿

1.0,过长的答案可能只拿0.8; - 步骤奖励:在多步任务里,不一定非要等到最后才给分。比如成功获取仓库结构

+0.1,成功读取关键文件+0.1,分析过程合理+0.2,最后报告质量高+0.6; - 组合奖励:把准确率、长度控制、步骤质量等信号加权组合起来,而不是只盯着最后答案。

从奖励形态上看,还可以分成三种:

- 稀疏奖励:只在任务结束时给一次奖励;

- 密集奖励:每一步都给小的反馈;

- 混合奖励:把最终结果奖励和中间步骤奖励结合起来。

这背后有一个非常重要的原则:你奖励什么,模型就会学什么。

如果只奖励“最后答对”,模型可能会学会一种并不好用的策略:虽然结果对了,但过程很啰嗦,或者中间步骤很乱。反过来,如果奖励里把“答对”“简洁”“步骤合理”都考虑进去,模型学到的行为通常会更接近我们真正想要的 agent。

如何评估一个 Agentic RL 模型

评估 Agentic RL,不能只看结果对不对,还要看它是怎么做对的、花了多大代价、以及在哪些地方容易出错。换句话说,Agentic RL 评估的不是一句最终答案,而是一整条 trajectory。

1. 先看核心指标

一个更完整的评估体系,通常可以拆成三类指标。

- 准确性指标(Accuracy):包括

Accuracy、pass@k、Numerical Error。其中pass@k很有价值,因为它衡量的是模型的潜力:对同一个问题采样 k 次,只要有一次答对就算通过。如果单次输出不稳定,但多采样后经常能命中正确答案,说明模型已经“会了”,只是策略还不够稳。 - 效率指标(Efficiency):包括

Average Length、Average Steps、Inference Time。Agent 不是越能想越好,真实系统里还要考虑 token 成本、响应延迟和执行开销。 - 过程质量指标(Quality):包括

Format Correctness、Reasoning Coherence、Explainability。因为很多 Agent 任务并不是只交付一个最终答案,而是需要保留一个可检查、可复盘、可继续执行的中间过程。

2. 不只打分,还要做 error analysis

知道模型错了还不够,更重要的是知道它为什么错。

常见错误大致可以分成四类:

- 计算错误:思路对了,但算错了;

- 推理错误:逻辑链路本身有问题;

- 理解错误:题目理解偏了;

- 格式错误:答案可能对,但不符合输出格式。

这个分类很有实践价值,因为不同错误,对应的改进手段完全不同:

- 计算错误,可能要加强 tool use 或数值校验;

- 推理错误,可能要优化 trajectory 奖励;

- 理解错误,可能要补充数据覆盖;

- 格式错误,可能需要加强 SFT 或格式奖励。

也就是说,评估不是为了生成一张漂亮的分数表,而是为了指导下一轮训练。

3. 还要看 generalization 和分层表现

除了总体分数,还应该看模型在不同难度、不同场景、不同任务类型下的表现。

比如同样是数学题,可以按推理步数划分:

- 简单题;

- 中等题;

- 困难题。

很多时候总体准确率看起来不错,但一拆分就会发现:

- 简单题表现很好;

- 一到长链路任务就明显掉点。

这说明模型未必真的具备了稳定的推理能力,而可能只是掌握了较浅层的模式匹配。对 Agent 来说,这种分层评估尤其重要,因为真实世界任务往往是长尾、复杂、动态的。

归根结底,一个完整的评估框架至少要回答四个问题:

- 任务完成了吗?

- 完成得稳不稳?

- 完成得高不高效?

- 完成过程是否合理、可解释、可复用?

这也是 Agentic RL 和普通 LLM 调优最不一样的地方:它评估的对象,从“输出文本”升级成了“决策过程”。

结语

Agentic RL 的真正价值,不只是把大模型的分数再提一点。

它更重要的意义在于:它把大模型从“回答问题的系统”推进成了“完成任务的系统”。

一旦训练目标从“生成更像人的回答”转向“在环境中持续做出更优决策”,模型的能力边界就会发生变化:

- 它会更重视长期目标;

- 更擅长处理多步任务;

- 更可能学会工具使用;

- 也更需要一套围绕“轨迹”和“行为质量”的评估体系。

所以,理解 Agentic RL,不能只盯着 RL 算法本身。更关键的是理解:我们到底希望 agent 学会什么,又该如何判断它真的学会了。

参考

- Hello-Agents 第十一章:

https://hello-agents.datawhale.cc/#/./chapter11/%E7%AC%AC%E5%8D%81%E4%B8%80%E7%AB%A0%20Agentic-RL - Hello-Agents 仓库:

https://github.com/datawhalechina/hello-agents